|

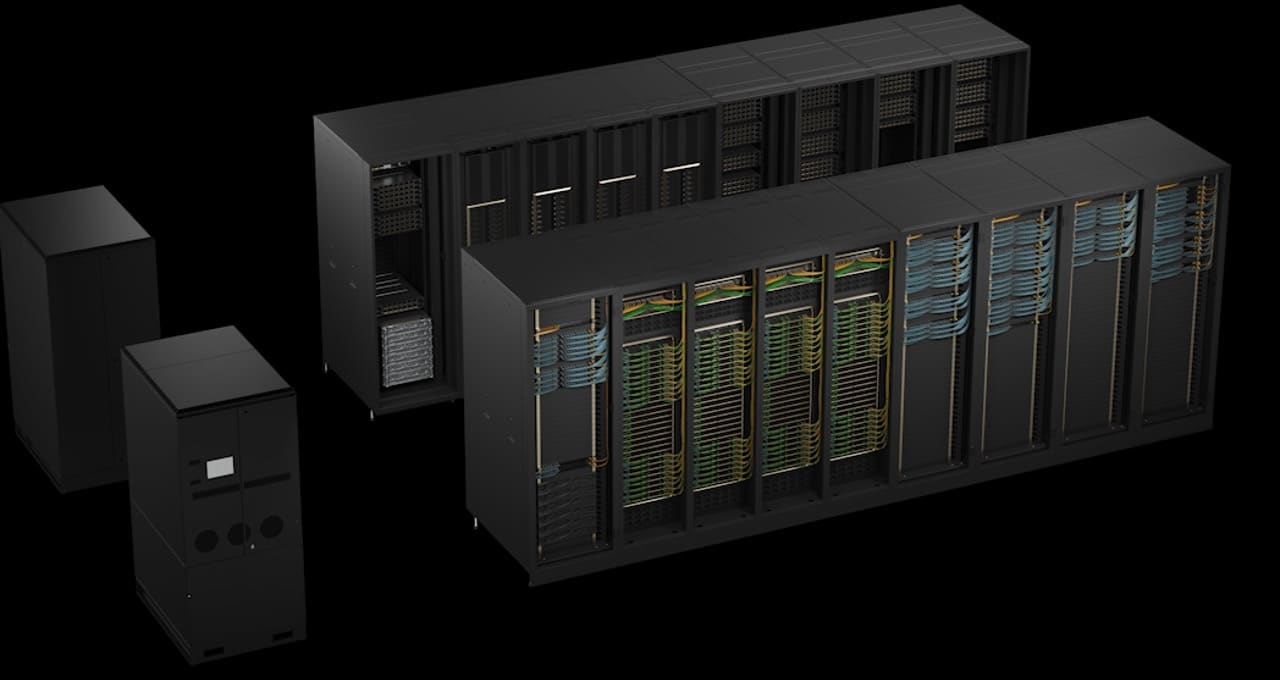

Yahoo 新闻:英伟达老总称:他的新产品可让DeepSeek模型跑得更快 英伟达首席执行官黄仁勋本周表示,他们公司最新推出的产品,有望显著提升DeepSeek R1模型的性能。 他强调,这家美国芯片巨头,在人工智能时代,具有不可替代的地位。 在加州圣何塞举行的公司年度GTC大会上,黄仁勋介绍了英伟达最新产品如何显著增强大型模型的推理能力,包括DeepSeek R1。 黄仁勋将英伟达最新发布的开源推理软件Dynamo描述为“AI工厂的操作系统”。 据英伟达介绍,Dynamo现已在Github上开放下载,并可在现有图形处理单元(GPU)和架构上提升多达30倍的AI推理性能。 英伟达作为全球AI竞争中的“唯一军火供应商”的地位在今年1月受到了挑战,当时总部位于杭州的DeepSeek推出了低成本,高性能的模型,引发了市场对昂贵AI芯片必要性的质疑。 应对挑战:英伟达寻求强化自身优势 由于美国出口管制,英伟达无法向中国出售其最先进的芯片。 在DeepSeek取得成功后,英伟达一直在努力应对“规模法则”(Scaling Law)带来的挑战,该理论认为,AI系统在投入更多资源后会获得更好的性能。 尽管DeepSeek的开源模型在中美政治紧张局势加剧的背景下引发了美国方面的警惕,但包括英伟达和超微半导体在内的美国芯片制造商仍争相支持这一在全球广受欢迎的AI模型。 英伟达技术提升:助力DeepSeek-R1推理速度 英伟达近期在博客中披露,一台搭载8颗Blackwell GPU的Nvidia DGX系统可在6710亿参数的DeepSeek-R1模型上实现每位用户每秒253个token的推理速度,峰值吞吐量可超过每秒3万个token。 自今年1月以来,英伟达团队已将R1模型的吞吐量提升了约36倍。 在GTC大会上,黄仁勋播放了一段视频,对比了Meta旗下的传统语言模型与DeepSeek-R1在处理座位安排问题上的表现。 Meta的模型仅消耗了439个token,但未能得出正确答案,而R1则使用了8,559个token,在探索多个可能性后最终得出了正确解。 黄仁勋表示,推理模型的发展将推动计算资源需求激增,并强调“规模法则”在AI发展的不同阶段依然适用。 新品发布:Blackwell Ultra GPU和未来架构计划 英伟达在大会上还宣布了多项技术突破,包括即将推出的Blackwell Ultra GPU,该产品专为推理模型优化,预计将在今年晚些时候出货。 此外,黄仁勋还预览了下一代Vera Rubin GPU架构,计划于2026年发布,并披露了预计2028年推出的Feynman架构。 其他技术更新还涉及机器人技术和量子计算研究。 本届GTC大会也吸引了中国科技巨头的参与,包括百度,阿里云和字节跳动等企业均出席了会议。 然而,DeepSeek本身并未参加本次大会。 不过,其母公司,高频量化对冲基金High-Flyer曾于2022年参加GTC,并展示了其AI计算资源调度技术。     来源: https://finance.yahoo.com/news/n ... DLrWELAekfgh5knuLM4 https://www.scmp.com/tech/big-te ... s-models-run-faster Wency Chenin Shanghai Wed, March 19, 2025 at 8:30 PM GMT+11 3 min read |